Microsoft Azure erhält sein erstes NVIDIA Blackwell “GB200 NVL72” -System für Openai und markiert einen großen Meilenstein für KI -Training und -entwicklung.

Microsoft erhält über 500 Blackwell GB200 -Chips in acht Racks GB200 NVL72 für den Azure OpenAI -Service

OpenAI erhält jetzt einen enormen Leistungsschub über das GB200 NVL72 “Blackwell” -System von NVIDIA. Während NVIDIA bereits die KI -Modelle von OpenAI angetrieben hat, wird die Erweiterung von Microsoft Azure die Leistung des Flaggschiff -GPU von NVIDIA durch strenge Training weiter verbessern.

Nvidia Blackwell ist da!

Heute freuen wir uns, die mit Spannung erwarteten @nvidia Blackwell GPUs zu Google Cloud mit der Vorschau von A4 VMs, die von Nvidia HGX B200 betrieben wird.

Erfahren Sie mehr → https://t.co/n1oqzmzj8m pic.twitter.com/iBtlquqsvg

– Google Cloud Tech (@googlecloudtech) 31. Januar 2025

In einem X -Post der CEO von Open AI, Sam Altmankündigte an, dass Microsoft Azure jetzt die ersten acht Racks des GB200 NVL72 -Systems ausführt. Sam dankte auch dem CEO von Microsoft, Satya Nadella, und dem CEO von Nvidia, Jensen Huang, dafür, dass er dies erreicht hat. Durch die Zusammenarbeit dieser Unternehmen kann der Azure OpenAI -Service Microsoft nun als einen der führenden Cloud -Anbieter für KI -Arbeitsbelastungen positionieren.

Der erste volle 8-Rak-GB200 NVL72, der jetzt in Azure für Openai ausgeführt wird-danke @Satyanadella Und Jensen!

– Sam Altman (@SAMA) 31. Januar 2025

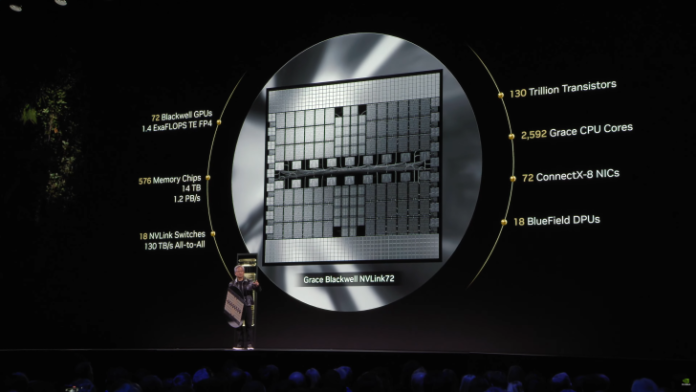

Das NVIDIA Blackwell GB200 NVL72-System enthält 36 Grace-CPUs und 72 Blackwell GPUs in einem Rack-Maßstab. Mit acht solcher Racks wird es insgesamt 288 Grace -CPUs mit einem satten Grace -CPUs geben 576 B200 GPUS. Dies kann eine unglaubliche Rechenleistung erzeugen, da ein einzelnes Rack zu bis zu 6.480 Tflops von FP32 und bis zu 3.240 Tflops mit FP64 -Leistung führen kann. Diese Rechenleistung kann jetzt achtmal multipliziert werden, was fast zu fast 51.840 tflops von FP32 und 25.920 tflops von FP64 Leistung.

Mit einer solchen außergewöhnlichen Rechenleistung kann der Azure OpenAI -Service für Unternehmen, die ihre Unternehmen skalieren möchten, von großem Nutzen sein. Die NVIDIA “Blackwell” GB200 NVL72 ist unglaublich leistungsfähig und optimiert für großflächige Generativen-KI-Workloads, da sie eine hohe Speicherbandbreite von bis zu 576 TB/s bietet und parallele Verarbeitungsleistung bietet.

OpenAI verwendet derzeit eine Vielzahl von NVIDIA -GPUs, darunter NVIDIA V100S, H100 und A100S, aber der Blackwell B200 ist der fortschrittlichste GPU -Chip, der seine Vorgänger erhebliche Leistung erhöht. Da Microsoft fast 14 Milliarden US -Dollar in OpenAI investierte, ist es keine Überraschung, dass es die Führung mit der leistungsstärksten Maschine für seine Kunden übernehmen möchte.